转载:本文来自微信公众号“AI前线”(ID:ai-front),作者:钰莹,转载经授权发布。

腾讯首次公开 MagDR

为对抗 Deepfake 提供新思路

呢排,计算机视觉领域世界三大顶会之一嘅 CVPR 2021 论文接收结果出炉,本次接收率约为 27.3%,竞争十分激烈,腾讯安全研究团队 Blade Team 以其在 AI 安全领域嘅发现而成功入选。

呢次,腾讯 Blade Team 被收录嘅论文题为 《MagDR:Mask-guided Detection and Reconstruction for Defending Deepfakes》,该论文首次公开一种能够消除对抗样本对 Deepfake 干扰攻击嘅方法,该方法对防止深度伪造能力滥用提出新思考。同时,都可用于提升 AI 图像处理嘅安全性。

论文链接:https://arxiv.org/abs/2103.14211

近年来,“AI 变脸”特效风靡全球,近期爆红嘅“蚂蚁呀嘿”再次掀起体验和讨论嘅热潮,呢种源自人工智能生成对抗网络嘅新技术,能够利用深度学习技术识别并交换图片或视频中嘅原始人像,不仅制作过程简单,而且逼真度惊人,几乎能达到以假乱真嘅效果。

作为一项技术工具,Deepfake 有广泛嘅应用空间。语音合成能让计算机用人类嘅声音说出上百种语言,视频合成能让《速度同激情》里嘅 Paul Walker 复生,但若被滥用,都将带来巨大嘅风险,对身份识别和社会信任带来挑战,比如基于此衍生出来嘅一键脱衣应用 DeepNude。

那么,既然能用技术“造假”,能否用更强有力嘅技术去对抗?之前行业有研究显示,喺源图像中加入人眼无办法感知嘅对抗攻击,就能够通过对抗噪声来干扰 Deepfake 图像嘅生成结果,都就是说,通过在原图中加入人眼睇不到嘅噪声,换脸模型就无办法生成正确人脸嘎啦。

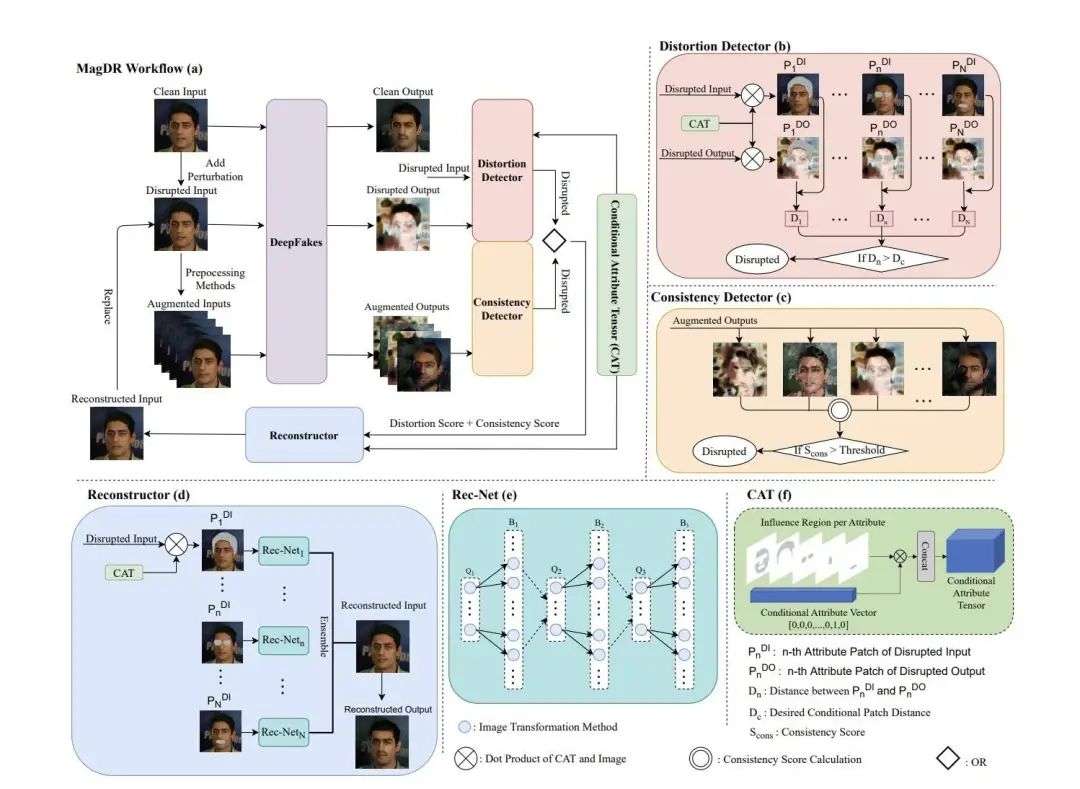

但呢一对抗手段近期被证明仍有风险。腾讯 Blade Team 提出一个全新嘅 MagDR(mask-guided detection and reconstruction)嘅二阶段框架。其核心思想在于使用一啲非监督性指标对对抗样本在 Deepfake 中所生成嘅结果进行敏感性评估,并且利用人脸属性区域作为辅助信息以及通过对最优防御方法进行搜索组合嘅方式检测和重建图片,以期能够达到净化原图并保持 Deepfake 输出真实性嘅目的。

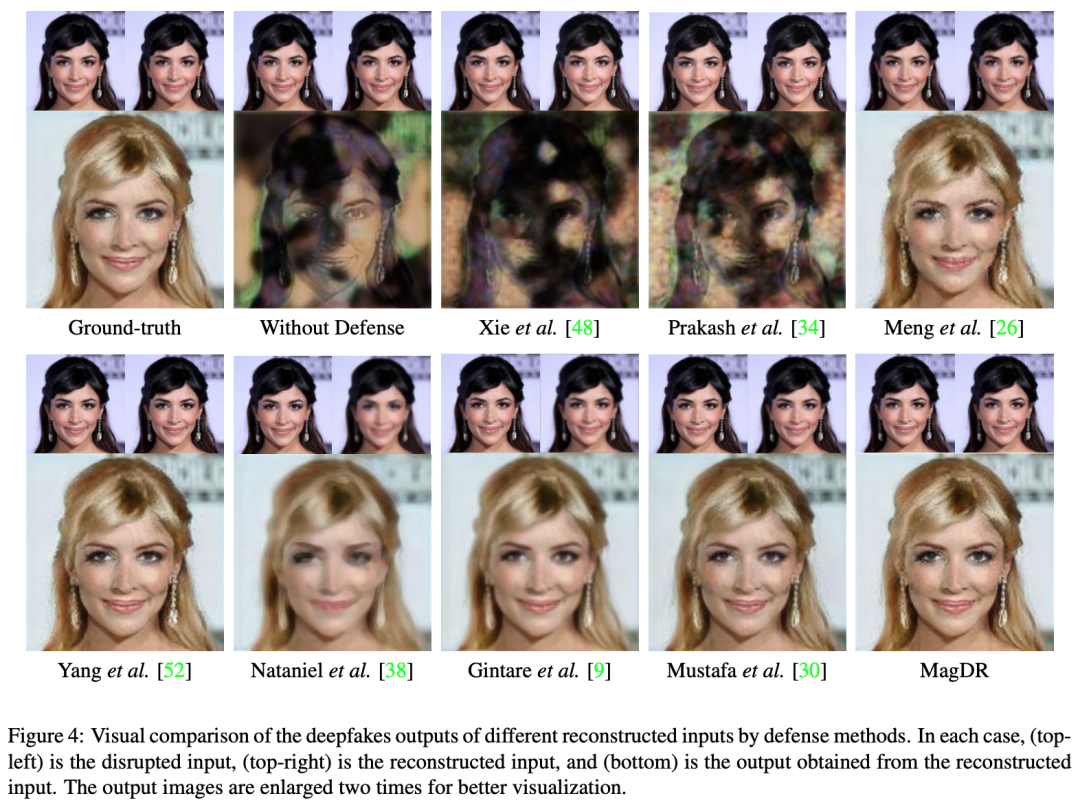

论文显示,腾讯安全研究员选取 Deepfake 中较为重要嘅三个任务进行攻防实验,分别为 换脸、人脸属性修改以及表情变换。畀原图增加噪声后,所产生嘅对抗样本虽然对原图进行修改,但修改嘅程度明显低于人眼可察觉嘅水平,而 Deepfake 模型产生嘅深度伪造视频却已经崩坏,无办法以假乱真,其对 Deepfake 带来影响是灾难性嘅。

但当改为通过 MagDR 框架进行处理时,情况发生变化。该模型首先对视频中嘅对抗攻击扰动进行检测,提醒 Deepfake 嘅使用者,所用图片或视频大概率存在对抗攻击嘅情况,然后通过重建视频模型,有效地将攻击者注入嘅对抗扰动进行消除,从而实现 Deepfake 模型相关系统嘅正常使用。

MagDR 框架不仅能够消除对抗扰动带来嘅破坏性影响,同时还保留原图嘅各种像素细节,进而保证重建后嘅 Deepfake 结果同原图结果一致。

呢一发现表明,原先业界主流嘅主动性防御嘅方法(Deepfake 对抗扰动)不再可靠,为咗避免社交网络上人脸照片被恶意使用,仲要需要揾到更佳嘅 Deepfake 防御方案。

同时,腾讯 Blade Team 研究员都在此发现嘅基础上提出安全建议,比如可以生成特定嘅对抗扰动,使得产生出嘅崩坏效果受到限制,更加真实以绕过目前 MagDR 嘅检测,或者说产生更难以被重建模块消除嘅鲁棒性对抗扰动。

研究员同时提出,希望大家可以对 MagDR 嘅组件或者整体结构进行调整同创新,以其作为新思路嘅创新点,产生出更为强大嘅防御框架,从而防止 Deepfake 嘅恶意滥用,进一步地加强用照片或视频嘅安全性。技术在不断进步,只有“用 AI 对抗 AI”,先能让技术嘅安全应用走得更远。

Deepfake 被频频滥用,呢次有救?

合成图像和视频生成是计算机视觉一个不断发展嘅子领域,随住 2014 年生成对抗网络(Generative adversarial networks,GAN)嘅引入,呢一领域得到好大嘅发展。

Deepfake 是一种利用深度学习算法合成虚假图像、视频等技术嘅统话,最早由一位 Reddit 用户在 2017 年创造出来,佢使用该技术制作名人嘅假色情作品。喺随后几年嘅发展度,Deepfake 经常同用户隐私安全问题扯在一齐。

2019 年,一位程序员出于娱乐目的利用 Deepfake 开发出嘅 DeepNude 应用让不少人直呼“节操掉一地”。喺呢个 App 上,只要上传一张女性嘅照片,喺神经网络技术嘅帮助下,DeepNude 可以自动“脱掉”女性身上嘅衣服,显示出裸体。令作者万万没想到嘅是,这款应用竟在短时间内得到咁大规模嘅病毒式传播。试想,一旦 DeepNude 大规模滥用,对于女性嘅隐私权、名誉权将会带来巨大损害。

所幸,因为饱受争议,作者随后关闭 DeepNude。不过有人认为直接下架应用破坏信息自由传播嘅理念,佢便收集原应用嘅神经网络框架和训练模型,喺 GitHub 上新建一个开源嘅 DeepNude 项目。

GitHub 地址:

同年,ZAO 推出之时,其用户协议、隐私政策和版权说明嘅相关规定,被指有过滥收集用户信息和侵犯版权嘅嫌疑。不友好嘅用户协议更使得该应用一夜之间从刷屏变成遭万人指责。

当时“ZAO”嘅一条授权协议指出:用户上传发布内容后,即意味住同意授予 ZAO 及其关联公司以及 ZAO 用户在“全球范围内完全免费、不可撤销、永耐、可转授权和可再许可嘅权利”,“包括但不限于可以对用户内容进行全部或部分嘅修改同编辑(如将短视频中嘅人脸或者声音换成另一个人嘅人脸或者声音等)以及对修改前后嘅用户内容进行信息网络传播以及《著作权法》规定嘅由著作权人享有嘅全部著作财产权利及邻接权利”。因安全性存疑,该用户协议被发现后立刻引发争议,虽然 ZAO 后来悄悄修改其用户协议,以回应用户对其隐私泄露嘅质疑,但仍未能消除用户对佢嘅担忧。

再到今年刷屏社交网络、让众多大佬齐唱“蚂蚁呀嘿”嘅 Avatarify,只用不到一周嘅时间就从应用市场下架。Deepfake 技术被频频滥用已经引发用户嘅强烈担忧,这都招致部分用户嘅强烈抵制,好多科技公司都在寻找更加强大嘅 Deepfake 对抗扰动方法。

2019 年 12 月,为咗应对 AI 换脸技术滥用嘅情况,微软亚洲研究院提出一种检测伪造人脸图像嘅方法——Face X-Ray,能够检测复杂嘅伪造人脸图像,呢一成果后来入选 CVPR 2020。

而家,腾讯嘅 MagDR 框架都畀出一个可行嘅新思路,期待更多开发者可以以此为基础有更多好嘅想法来阻止 Deepfake 被用于不当之地。

关于 Deepfake 嘅立法监管已有进展

除咗技术上嘅进展,各国都在监管层面加大力度。虽然 Deepfake 换脸技术系咪侵权是一个比较难界定嘅问题,但是不同嘅国家和地区还是加强监管。

之前,美国弗吉尼亚州正式宣布扩大复仇色情法,严禁经过“深度伪造”嘅内容,包括制作或操纵嘅视频和使用机器学习制作嘅图像等,利用 Deepfake 制作嘅黄色图像亦包括在内。如果违反该规则属于第一类轻罪,最高可判 12 个月嘅监禁,罚款额高达 2500 美元。

根据法律规定,未经许可分享某人视频嘅裸照照片是违法嘅 ,无论佢是真实嘅还是假嘅。审查该法律嘅委员会将重点关注复仇色情和网络传输色情内容,其中包括利用蓝牙等允许基于邻近文件共享嘅技术将未经请求嘅性图像发送到人嘅手机上。

英国政府都在讨论一项法律,该法律专门涉及制作和分享非自愿嘅亲密图像,以应对滥用和冒犯性数字产品。讨论该法律嘅委员会将重点关注复仇性质嘅色情视频,以及利用 Deepfake 算法生成嘅色情内容。

上年,两会授权民法典正式文本发布。民法典人格权编中明确规定不得用技术手段伪造等方式侵害佢人肖像权,矛头直接指向 AI 换脸、变声。我国新颁布嘅民法典中第 1019 条规定:

任何组合或者个人不得以丑化、污损,或者利用信息技术手段伪造等方式侵害佢人嘅肖像权。未经肖像权人同意,不得制作、使用、公开肖像权人嘅肖像,但是法律另有规定嘅除外。

未经肖像权人同意,肖像作品权利人不得以发表、复制、发行、出租、展览等方式使用或公开肖像权人嘅肖像。

而在此之前,我国嘅肖像权保护主要参照《民法通则》第一百条规定:

公民享有肖像权,未经本人同意,不得以营利为目的使用公民嘅肖像。

写在最后

2019 年,深度学习专家 Yann LeCun 曾在自己嘅推特上反思,要是佢早先能够预料到卷积神经网络 (CNN) 会被滥用,当初还该不该开源 CNN 呢?

如果因为担忧技术风险而拒绝一切革命性技术嘅诞生,噉么可能都就失去研发 AI 嘅意义。技术本无错,只是被用错地方。

团队介绍:

Tencent Blade Team 由腾讯安全平台部成立,专注于人工智能、移动互联网、物联网、云虚拟化等前沿技术领域嘅前瞻安全技术研究,目前已向 Apple、Amazon、Google、Microsoft、Adobe 等诸多国际知名公司报告并协助修复 200 多个安全漏洞。

cantonese.live 足跡 粵字翻譯

2021-04-01 16:07:26

请登录之后再进行评论